O Judiciário brasileiro enfrenta desafios como sobrecarga de processos e necessidade de uniformização de decisões. Nesse cenário, a IA surge como aliada para tarefas repetitivas e análises complexas. Contudo, a adoção dessas tecnologias deve respeitar princípios constitucionais, como devido processo legal e ampla defesa, evitando que algoritmos assumam funções decisórias ou prejudiquem a autonomia do magistrado.

A questão apresentada no ENAM2025.2, na disciplina Direito Digital, trata da utilização de inteligência artificial pelo Tribunal de Justiça do Estado Alfa (TJ-Alfa), com base nas diretrizes da Resolução nº 615/2025 do Conselho Nacional de Justiça.

Essa norma estabelece princípios para o desenvolvimento e governança de soluções de IA no Judiciário, visando garantir segurança, ética e proteção aos direitos fundamentais. Entre as disposições, destaca-se que, caso seja identificado viés discriminatório ou incompatibilidade da solução com os princípios da resolução, devem ser adotadas medidas corretivas imediatas, que podem incluir suspensão temporária, correção ou até eliminação definitiva da solução ou do viés. Essa exigência reforça a importância da supervisão contínua e da conformidade com padrões éticos e legais. A alternativa correta é a letra C, por estar alinhada às medidas de governança previstas na resolução.

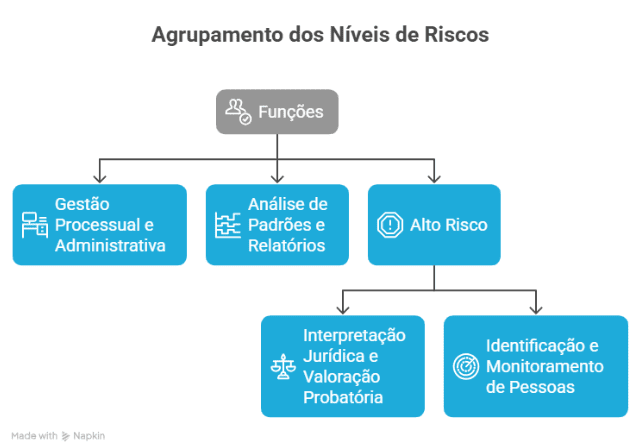

Vamos aos comentários: as demais alternativas da questão estão incorretas por violarem dispositivos expressos da resolução. É obrigatório anonimizar dados sigilosos ou protegidos por segredo de justiça, conforme o art. 7º, § 2º, o que invalida a alternativa A. A alternativa B também é vedada, pois não se admite que soluções de IA classifiquem ou ranqueiem pessoas com base em comportamento, situação social ou atributos pessoais, conforme art. 10, III. A alternativa D está errada porque a interoperabilidade por meio de APIs é essencial, não prescindível, conforme art. 12, VII. Por fim, a alternativa E mistura conceitos: embora a interoperabilidade seja relevante, essa diretriz não é uma exigência específica para soluções de alto risco antes da produção, mas sim uma orientação geral do art. 12, IV.

O monitoramento das soluções de inteligência artificial no Judiciário é essencial para garantir segurança e conformidade ética. As aplicações classificadas como de alto risco devem passar por auditorias regulares e acompanhamento contínuo, visando mitigar riscos aos direitos fundamentais, à privacidade e à justiça. Além disso, a categorização dessas soluções será revisada anualmente pelo Comitê Nacional de Inteligência Artificial do Judiciário, assegurando atualização frente às exigências legais.

Já as soluções de baixo risco também requerem monitoramento periódico, para confirmar que permanecem dentro dos parâmetros estabelecidos. Essa prática evita que mudanças tecnológicas ou contextuais alterem sua classificação. Assim, o processo de supervisão contínua reforça a transparência e a confiança no uso da IA no âmbito judicial.

O uso da IA no Judiciário suscita questões éticas relevantes, como transparência algorítmica, prevenção de vieses e proteção da privacidade. É imprescindível que os sistemas sejam auditáveis e que seus critérios de funcionamento sejam claros, evitando decisões opacas que possam comprometer a confiança pública na Justiça.

Mesmo em tarefas de baixo risco, a supervisão humana é obrigatória. A IA deve atuar como ferramenta de apoio, nunca como substituta da função jurisdicional. Essa diretriz reforça a ideia de que a tecnologia deve servir à Justiça, e não o contrário, preservando a autonomia decisória e a dignidade da pessoa humana.

Quando aplicada de forma ética e segura, a IA pode reduzir a morosidade, melhorar a gestão de dados e uniformizar entendimentos jurisprudenciais. Contudo, os benefícios só se concretizam se houver mecanismos robustos de governança, monitoramento contínuo e capacitação dos operadores do direito para lidar com essas ferramentas.

A contextualização da IA no Judiciário brasileiro exige equilíbrio entre inovação e proteção de direitos. A classificação de riscos prevista na Resolução nº 615 é um marco regulatório essencial para garantir que a tecnologia seja utilizada com responsabilidade, ética e transparência. O futuro da Justiça digital depende da harmonização entre eficiência tecnológica e princípios fundamentais do Estado de Direito.

• Nome: Tiago Carneiro Rabelo

• Professor da Lei n. 11.419/2006 – Processo Judicial Eletrônico, Direito Digital e Resoluções tecnológicas do CNJ no GRAN.

Rede social – Instagram: @prof.tiagorabelo

![[OPERAÇÃO XEQUE-MATE] Preço R$ 54,90 – Cabeçalho](https://blog-static.infra.grancursosonline.com.br/wp-content/uploads/2026/03/04163344/operacao-xeque-mate-cabecalho.webp)

![[OPERAÇÃO XEQUE-MATE] Preço R$ 54,90 – Post](https://blog-static.infra.grancursosonline.com.br/wp-content/uploads/2026/03/04164337/operacao-xeque-mate-post.webp)